Efekt? Wiemy o świecie znacznie mniej niż byśmy mogli. Wypracowane przez nas przekonania i opinie tylko się pogłębiają, a ich zmiana staje się prawdziwym wyzwaniem.

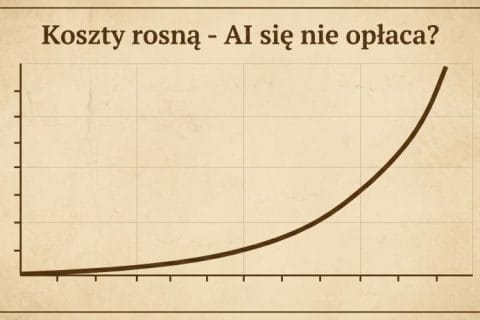

Jeśli przeczytanie tekstu do tego fragmentu zajęło ci mniej więcej minutę, to w tym czasie w internecie przybyło ok. 1200 gigabajtów danych. Gdy pracujemy i śpimy w sieci pojawiają się miliony nowych treści – informacji, zdjęć, filmów i nowych aplikacji.

Szacuje się, że w globalnej sieci mamy już 10 jottabajtów danych (nawet nie pytajcie, ile to dokładnie). My z kolei każdego dnia możemy wchłonąć zaledwie 34 gigabajty informacji.

O nierównościach, które tworzą technologie pisze na naszym portalu Rafał Pikuła.

W trakcie całego życia poznajemy więc jedynie skromny wycinek wszystkich pojawiających się informacji. O to byśmy nie utonęli w jottabajtach danych dbają specjalne algorytmy, które starannie selekcjonują dla nas pojawiające się w mediach społecznościowych informacje.

W sieci każdy ruch ma znaczenie

Gdy jadąc tramwajem albo nudząc się w kolejce do kasy przeglądamy Facebooka, często nie zdajemy sobie sprawy, że każdy nasz ruch jest pieczołowicie analizowany, a nam algorytmy przypisują określone osobowe metki. Ku mojemu wielkiemu zdziwieniu odkryłem, że algorytmy Facebooka – prawdopodobnie na podstawie odwiedzanych stron – rozszyfrowały moje preferencje polityczne i w dodatku wcale się z tym nie kryje.

Zresztą, sprawdźcie sami czy algorytmy Facebooka przejrzały was na wyrost. Gdy następnym razem podczas przeglądania Facebooka wyświetli się wam reklama, wybierzcie opcję „dlaczego mi się to wyświetla?”. Bardzo prawdopodobne, że największe medium społecznościowe świata wie o was coś, czego sami byście dobrowolnie nie przekazali.

Nie bez powodu Facebook nazywany jest największą agencją reklamową świata. Dysponuje on milionami danych na temat swoich użytkowników, co pozwala potencjalnym reklamodawcom dotrzeć do konkretnej, niekiedy bardzo wąskiej grupy odbiorców. Możemy przykładowo zapłacić za to, by nasza reklama dotarła do użytkowników mieszkających w wielkich metropoliach, słuchających islandzkich girls-bandów i interesujących się średniowieczną ornitologią.

Oprócz aspektu stricte finansowego media społecznościowe zbierają nasze dane po to, byśmy nie utonęli w gąszczu pojawiających się co chwilę nowych informacji. Na podstawie wskazanych przez nas zainteresowań i wykonywanych działań (wyszukiwania, polubienia, komentarze, udostępnienia) Facebook może selekcjonować za nas informacje i wyświetlać jedynie te, które są zgodne z naszymi preferencjami. Brzmi dobrze, ale czy z korzyścią dla nas? Gdy wyświetlają się nam jedynie spersonalizowane treści, zgodne z naszymi oczekiwaniami i poglądami, dochodzi do powstania bańki informacyjnej.

Kto kontroluje algorytmy Facebooka?

Wielu użytkowników zupełnie nieświadomie przekazuje kontrolę nad pewnymi życiowymi wyborami w ręce algorytmów. Media społecznościowe nie wyświetlają nam treści, które prawdopodobnie zostałyby przez nas zignorowane, jednak wskazują, czym powinniśmy się zainteresować. Spotify podrzuca najlepszą playlistę. Filmweb podpowiada, który film obejrzeć wieczorem. Facebook, które treści naszych znajomych powinniśmy przeczytać w pierwszej kolejności. Na pierwszy rzut oka wszystko wydaje się w porządku. Czytamy tylko to, co nas interesuje i nie tracimy czasu na głupoty. Spójrzmy na to jednak z innej strony.

Pamiętacie może, jak wyglądała Wasza facebookowa strona aktualności po wynikach ostatnich wyborów prezydenckich? Tysiące internautów dziwiło się, że wspierana przez nich partia przegrała, bo „przecież wszyscy pisali, że są przeciwko”. Niestety mało kto zdaje sobie sprawę, że opozycyjny głos po prostu się nie wyświetlał, co nie znaczy, że nie istniał.

Gdy selekcja informacji odbywa się bez naszej zgody i wiedzy praktycznie nie docierają do nas informacje, z którymi moglibyśmy się nie zgadzać. Nie docierają także takie, które mogłyby nam się wydać kontrowersyjne. Jeśli nie chcemy stać w miejscu, takie treści muszą docierać do naszej świadomości. Inaczej nigdy nie poszerzymy naszej wiedzy o świecie i nie poddamy w wątpliwość utartych schematów myślowych i poglądów.

Motorem napędowym rozwoju są przede wszystkim zmiany. Gdy zamykamy się w kokonie bańki informacyjnej nie mamy na nią najmniejszych szans. Nie poddajemy w wątpliwość swoich poglądów i nie dostrzegamy tych opozycyjnych do naszych.

Gdy docierają do nas wyłącznie treści zgodne z naszymi osądami, możemy ulec złudnemu wrażeniu, że wszyscy podzielają nasze przekonania. Gdy już trafimy na osobę, która poglądy ma odwrotne do naszych, to je odrzucamy. Automatycznie zakładamy, że nasz oponent jest w błędzie. Dochodzi wtedy do radykalizacji własnych poglądów i polaryzacji grup o odmiennych przekonaniach.

To szczególnie groźne biorąc pod uwagę, że dla 88 proc. millenialsów Facebook jest wiodącym źródłem pozyskiwania wiedzy o świecie (American Press Institute).

Pułapki myślowe

Przez całe życie stosujemy rozmaite skróty myślowe, które pozwalają nam funkcjonować w skomplikowanej rzeczywistości. Pełne zrozumienie każdej niejasnej dla nas kwestii byłoby wyzwaniem nie do przejścia, dlatego sięgamy chociażby po stereotypy. Dzięki nim możemy zredukować nadmiar docierających do nas informacji i uporządkować pewien wycinek rzeczywistości.

Co ciekawe, w mediach społecznościowych to najczęściej algorytmy naprowadzają nas na kolejne pułapki myślowe. Jednym ze skrzywień poznawczych jest tzw. błąd konfirmacji, czyli tendencja do wybierania i preferowania informacji zgodnych z naszymi poglądami.

Znacznie większym problem, który pojawia się przy selekcjonowaniu informacji przez algorytmy, jest manipulowanie opinią publiczną. Informacje są wówczas selekcjonowane tak, by jak najsilniej wpłynąć na nasze poglądy.

Z takim zjawiskiem mieliśmy do czynienia podczas wydarzeń związanych z Brexitem i wyborami prezydenckimi w Stanach Zjednoczonych (sprawa Cambridge Analitica). Na podstawie danych użytkowników udało się wyodrębnić tych, którzy nie są w pełni utwierdzeni w swoich poglądach. Wybranym internautom prezentowano wówczas szczegółowo dopasowane do nich informacje, co miało następnie wpłynąć na określony wybór podczas wyborów czy głosowania.

Największy problem polegał jednak na tym, że przekazywane niezdecydowanym wyborcom informacje były najczęściej fake-newswami, czyli całkowicie nieprawdziwymi wiadomościami. Miały one poruszać najbardziej podstawowe ludzkie emocje, takie jak strach czy lęk.

Z powodu rozprzestrzenianych masowo zmyślonych informacji meksykańscy imigranci zaczęli być niesłusznie kojarzeni z chorobami. Mieli przenosić wirusy. To miało wzbudzić uzasadniony lęk wśród niezdecydowanych wyborców. A pod wpływem radykalizacji swoich poglądów – wyborcy mieli zagłosować na określonego kandydata z rygorystycznym podejściem do imigracji w Stanach Zjednoczonych.

Złudne przekonania

Niezwykle ważna jest więc świadomość użytkowników o fake-newsach, a także znajomość narzędzi, które pozwalają z nimi walczyć. Wielu internautów niesłusznie ulega złudnemu przekonaniu, że ich dobry znajomy z pewnością nie wprowadziłby ich w błąd. Dlatego udostępniana przez niego informacja z pewnością jest prawdziwa. To dość naiwne podejście, które potrafi sprowadzić na manowce.

Problemem są też wszelkiej maści celebryci i liderzy opinii którzy często całkowicie nieświadomie przekazują dalej fake-newsy. Obdarzający ich zaufaniem odbiorcy nie widzą często potrzeby weryfikowania przekazywanych informacji.

Gdy wyświetlana wiadomość wzbudza jakiekolwiek wątpliwości, warto ją zweryfikować. Gdy portal, na którym wyświetlana jest informacja nie jest szerzej znany, a autor nie odważył się przedstawić z imienia i nazwiska, powinno to wzbudzić nasze podejrzenia. Bardzo dobrym narzędziem do weryfikowania informacji jest agregator treści Google News. Wpisując charakterystyczną dla danej wiadomości frazę możemy sprawdzić, jak wiele portali zajęło się danym tematem, a co najważniejsze – jak dokładnie go przedstawiło.

Jaki interes w podbijaniu fake-newsów ma Facebook? w To bardzo intratna sprawa. Portal Marka Zuckerberga nie bez kozery nazywany jest największą agencją marketingową świata. Dane, które użytkownicy bezrefleksyjnie wprowadzają są sumiennie zbierane, analizowane, a monetyzowane.

Mało kto pamięta, że zakładając facebookowe konto poinformował portal Marka Zuckerberga, o tym, jakie ukończył studia, gdzie mieszka czy czym się interesuje. Oprócz tego na podstawie odwiedzanych stron czy wybieranych materiałów portal może rozszyfrować choćby poglądy polityczne swoich użytkowników.

Wszystkie te informacje są niezwykle cenne dla potencjalnych reklamodawców. Facebook dosłownie im je sprzedaje. Reklamodawca określa swoją docelową grupę odbiorców, wybierając przykładowo ich wiek, wykształcenie i zainteresowania, a Facebook – za odpowiednią opłatą – wyświetla je sprecyzowanym wcześniej użytkownikom.

Przebijanie bańki

Google i Facebook przekonują jednak, że cel filtrowania przez nich informacji jest co najmniej szczytny. Największa światowa wyszukiwarka chwali się, że jej misją jest „uporządkowanie światowych zasobów informacji, tak by stały się powszechnie dostępne i użyteczne”. Facebook z kolei deklaruje „wsparcie ludzi w budowaniu wspólnoty i łączeniu świata ze sobą”.

Wszystko jednak ma swoją cenę. Styczność jedynie z takimi informacjami, które utwierdzają nas we własnych poglądach zamyka nas w bańkach informacyjnych. Stajemy się zdani na łaskę algorytmów, które w skrajnych przypadkach mogą nawet manipulować naszą opinią w imię politycznych celów.

Nie powinniśmy jednak czuć się zniewoleni. To przecież my dokonujemy selekcji źródeł i żadna z technologii nie zmusi nas do oddania się wir wybranych przez nią informacji.

Dobrym sposobem na przebicie bańki informacyjnej jest pewnego rodzaju masochizm informacyjny. Odwiedzajmy profile, na których wygłaszane tezy nie są zbieżne z naszymi. To pozwoli lepiej zrozumieć osoby, których poglądy stoją w opozycji względem naszych. Taki eksperyment pomoże lepiej zrozumieć wszelkich oponentów, poszerzy nasze pole argumentacji, a być może przebije coś, w co ślepo wierzymy od wielu lat.

Świadomość istnienia informacyjnych baniek, to pierwszy krok do tego, by się od nich uniezależnić. Skoro to my decydujemy co klikamy, komentujemy i przekazujemy dalej dywersyfikujmy źródła informacji. Zaglądajmy tam, gdzie zazwyczaj byśmy nie zajrzeli. Jeśli uważamy się za wyborców lewicowych sprawdźmy, jak wygląda prawicowy internet.

Nie dajmy też sobą manipulować w imię politycznych celów. Gdy jakakolwiek informacja wzbudzi nasze podejrzenia, zastanówmy się, czy ktoś nie stworzył jej po to, by sprowadzić nas na manowce. Jeśli to Was nie przekonało, to warto obejrzeć dokument The Social Dilemna – otwiera oczy.

Ilustracja: Travus dla homodigital

0 komentarzy

0 komentarzy