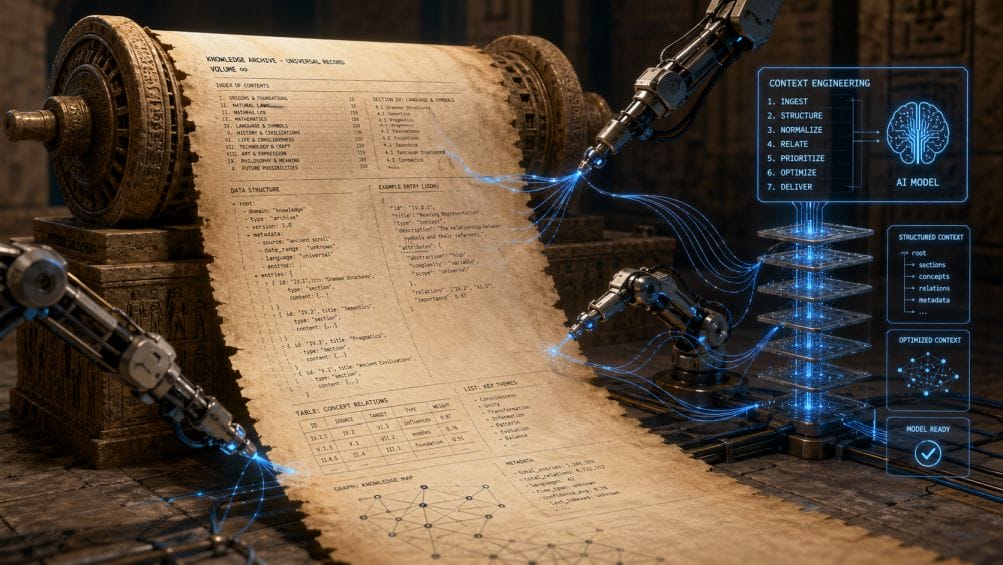

Za każdym razem, gdy zadajemy pytanie, model językowy nie ma dostępu do żadnej magicznej wiedzy o nas. Dostaje kartkę – bardzo długą kartkę – na której zapisane jest wszystko, co „powinien wiedzieć” na potrzeby tej konkretnej odpowiedzi. Ta kartka to właśnie kontekst. I to, co na niej ląduje — oraz jak to jest ułożone — ma znacznie większy wpływ na jakość odpowiedzi niż samo sformułowanie pytania.

Jak to działało kiedyś

Cofnijmy się o kilka lat. Gdy pojawiły się pierwsze powszechnie dostępne chatboty, kontekst był stosunkowo prosty. Składał się z dwóch elementów: promptu systemowego — tekstu napisanego przez twórcę aplikacji, który definiował charakter, zasady i „osobowość” bota — oraz bieżącej rozmowy między użytkownikiem a modelem.

Użytkownik dostawał narzędzie skonfigurowane przez kogoś innego. Jego wpływ na to, co AI „wiedziała” o nim, sprowadzał się właściwie do tego, co napisał w danej sesji. Koniec rozmowy — reset. Następna sesja — tabula rasa.

To był model, w którym kontekstem zarządzali przede wszystkim twórcy narzędzia. Użytkownik był jego konsumentem.

Inżynieria kontekstu to kilka warstw

Dziś sytuacja jest zasadniczo inna. Nowoczesne systemy AI — i mówię tu nie tylko o chatbotach, bo Cowork to już coś więcej niż chatbot — budują kontekst z wielu warstw jednocześnie. I coraz więcej z tych warstw zależy – przynajmniej w części – od użytkownika.

Pierwsza, najbardziej oczywista warstwa to wciąż prompt systemowy. Nadal istnieje, nadal definiuje reguły i charakter narzędzia. Ale przestał być jedynym graczem.

Druga warstwa to historia rozmowy — to, co powiedzieliśmy w bieżącej sesji. I wielu użytkowników myśli, że to właśnie tu „kontekst się kończy”.

Tymczasem coraz ważniejsza staje się trzecia warstwa: pamięć. Mam na myśli tę budowaną świadomie — gdy piszemy do Claude’a „zapamiętaj, że pracuję jako freelancer i moi klienci to głównie małe firmy produkcyjne”, albo gdy ChatGPT pyta po rozmowie, czy chcemy, żeby zapamiętał jakiś fakt. Ta pamięć trafia do bazy wiedzy danego narzędzia AI i przy każdej kolejnej rozmowie jest doklejana do kontekstu — cicho, w tle, bez naszego udziału.

I wreszcie warstwa czwarta, najciekawsza i chyba najmniej doceniana: pamięć automatyczna. AI nie czeka, aż ją czegoś nauczymy. Obserwuje wzorce. Notuje preferencje. Wyciąga wnioski. Jeśli za każdym razem, gdy prosisz o tekst, korygujesz zdania na krótsze — AI to zapamiętuje. Jeśli zawsze odrzucasz propozycje z emotikonami — AI to notuje. Budujesz model samego siebie, często nawet o tym nie wiedząc.

Tutaj uwaga – użytkownicy w UE nie skorzystają z tego ostatniego rodzaju pamięci w Gemini. Google wyłączył tę opcję w ramach przepychanek z unijnymi władzami.

Inżynieria kontekstu – nie wszystko do jednego worka

Tu dochodzimy do chyba najciekawszego i najmniej intuicyjnego aspektu całej układanki. Nowoczesne narzędzia AI nie mają już tylko jednej, globalnej pamięci. Mają również pojemniki na pamięć.

Claude ma Projekty. ChatGPT też. Gemini ma Notatniki (choć do Polski zdaje się nie doszły). Cowork ma zadania. Idea jest ta sama: wyodrębniony kontener z własną pamięcią, własnym zestawem dokumentów, z własną wersją promptu systemowego. Coś, co można opisać, zamknąć, otworzyć za tydzień i wrócić dokładnie tam, gdzie się skończyło — bo kontekst na ciebie czeka.

To zmienia absolutnie wszystko. Wcześniej praca z AI przypominała trochę rozmowę przez telefon z nieznajomym: koniec rozmowy, koniec wiedzy. Teraz bardziej przypomina pracę z dobrze zorganizowanym asystentem, który ma osobne teczki na każdy projekt. Teczka „projekt Nowy Produkt” wie czym ten produkt jest, jacy są docelowi klienci i w jakim ten projekt jest stadium. Teczka „zeznanie podatkowe” wie coś zupełnie innego. I jedno nie miesza się z drugim.

To wyodrębnienie kontekstu to nie tylko wygoda. To też bezpieczeństwo i higiena pracy. Nie chcesz, żeby AI, gdy pomagasz pisać umowę z klientem, miała w tle wiedzę o twoich prywatnych finansach czy problemach zdrowotnych. Pojemniki pozwalają na świadome zarządzanie tym, co „wie” AI w danym kontekście.

Kiedy dobry prompt wciąż jest kluczowy

Powiedzieliśmy sobie, że inżynieria kontekstu to coś więcej niż prompt. Ale prompt wciąż ma swoje miejsce — i to ważne. Jest nim każda sytuacja, gdy musisz zbudować nowy kontekst od zera.

Wyobraź sobie, że planujesz wyjazd za granicę. Tyle że tym razem nie z rodziną a z dwójką przyjaciół, którzy mają zupełnie inne preferencje niż Twoi domownicy. Nie chcesz muzealnych tras i spokojnych kolacji o 18:00. Chcesz więcej klimatycznych barów, spontanicznych decyzji, nieco droższych restauracji bez menu dla dzieci. AI, która „zna cię” z dotychczasowych rozmów, może tu być wręcz przeszkodą — bo niesie bagaż wcześniejszego kontekstu.

W takich momentach dobrze skonstruowany prompt jest niezbędny. I tu pojawia się wskazówka, którą rzadko się omawia: warto sięgać po dane strukturyzowane.

Zamiast pisać:

„Jadę z przyjaciółmi, lubią dobre jedzenie i wino, są aktywni, nie lubią turystycznych pułapek”

Spróbuj czegoś takiego:

Profil podróżników:

— Osoby: 3 dorosłych (bez dzieci)

— Styl: miejski, nastawiony na gastronomię i lokalną kulturę

— Budżet restauracji: średnio-wysoki

— Tempo: spontaniczne, nieplanowane co do godziny

— Unikamy: atrakcji z tłumem turystów, typowych „instagramowych” miejsc

Cel wyjazdu: Barcelona, 4 dni w maju

Czego szukamy: rekomendacji dzielnic, restauracji, barów popularnych wśród autochtonów

Format ma znaczenie. Markdown z nagłówkami, listy, a nawet JSON w bardziej zaawansowanych zastosowaniach — to nie jest fanaberia. To sposób na powiedzenie AI: oto hierarchia tych informacji, oto co jest ważne, a co jest szczegółem. Model językowy naprawdę lepiej rozumie strukturę niż strumień świadomości.

Ten sam mechanizm powinniśmy stosować przy każdym „zerowym” kontekście: nowy projekt zawodowy, zmiana pracy, zupełnie nowy temat, w którym AI nie ma żadnej bazy wiedzy o nas. Wtedy inżynieria promptu i inżynieria kontekstu spotykają się w jednym miejscu — i dobry, ustrukturyzowany prompt jest pierwszym krokiem do zbudowania dobrego kontekstu.

Inżynieria kontekstu – na czym polega w praktyce

Skoro kontekst to wielowarstwowy, konfigurowalny zasób — umiejętność zarządzania nim staje się realną kompetencją. Co to znaczy w praktyce?

Świadome budowanie pamięci. Nie zakładaj, że AI sama wywnioskuje to, co dla ciebie ważne. Powiedz jej wprost. „Jestem architektem, piszę głównie dla niespecjalistów, nie lubię list wypunktowanych.” Jedna minuta inwestycji — zysk przy każdej kolejnej rozmowie.

Organizacja projektów. Zamiast wszystko wrzucać do jednej, globalnej rozmowy, twórz projekty tematyczne. Projekt dla klienta A, projekt dla klienta B, projekt „wyjazd do Barcelony”. Każdy z własnym kontekstem, własnymi dokumentami.

Pilnowanie jakości kontekstu. Pamięć AI to nie magazyn — to filtry. Złe informacje w pamięci dają złe wyniki. Warto od czasu do czasu przejrzeć, co AI „zapamiętała” o tobie i skorygować błędy lub nieaktualności.

Rozumienie limitów. Okno kontekstu ma swój fizyczny rozmiar. Przy bardzo długich rozmowach AI zaczyna „zapominać” rzeczy z początku. To nie błąd — to mechanizm. Rozwiązanie: nowe projekty zamiast niekończących się wątków, streszczenia zamiast pełnej historii.

Nie tylko chatbot

Wróćmy do zdania, którym zacząłem tę część rozważań: Cowork to nie chatbot. I to zdanie doskonałe ilustruje, gdzie zmierza cała ta technologia.

Tradycyjny chatbot to narzędzie do rozmowy. Kontekst zaczyna się i kończy z konwersacją. Cowork — podobnie jak rosnąca klasa narzędzi AI do pracy — to środowisko. Kontekst jest tu stały, wielowarstwowy i celowo skonstruowany. AI nie czeka na twoje pytanie — może działać na podstawie zadań, dokumentów, danych z zewnętrznych integracji. Kontekst to tu nie tło rozmowy, ale fundamentalny zasób, który decyduje o jakości całej pracy.

Dlatego słowo „chatbot” powoli przestaje być adekwatne. I dlatego termin „inżynieria kontekstu” nabiera znaczenia szerszego niż tylko „jak dobrze napisać prompt”.

AI lubi porządek

Lubię myśleć o kontekście AI jak o biurku. Możesz mieć na nim totalny bałagan — wszystkie projekty, prywatne sprawy, notatki sprzed dwóch lat, połówka paragonu i kubek po kawie wypitej kilka dni temu. AI będzie próbowała z tego skorzystać, ale wyniki będą odpowiednio chaotyczne.

Albo możesz to biurko świadomie urządzić. Każdy projekt ma swoje miejsce. Na wierzchu leży to, nad czym teraz pracujesz. Nieaktualne rzeczy są w szufladzie lub wyrzucone di kosza. AI, która dostaje dostęp do takiego biurka, jest radykalnie bardziej użyteczna.

Prompt engineering nauczył nas, jak prosić. Inżynieria kontekstu uczy nas, jak myśleć o tym, co AI w ogóle dostaje do czytania — zanim jeszcze otworzymy usta. I to drugie, w erze AI jako codziennego narzędzia pracy, jest ważniejsze.

Źródło grafiki: Sztuczna inteligencja, model GPT Image 2

0 komentarzy

0 komentarzy