O obecnych czasach niewiele trzeba, żeby za pomocą narzędzi AI przekonująco przedstawiać prawdziwych ludzi mówiących coś, czego nigdy nie powiedzieli lub wykonujących różne czynności, których nigdy w rzeczywistości nie wykonywali. To bardzo realistyczne podróbki zamieniające twarze, odzwierciedlające realistyczne ruchy mimiczne lub syntetyzujące głosy w celu rozpowszechniania dezinformacji lub popełniania oszustw i dokonywania wymuszeń.

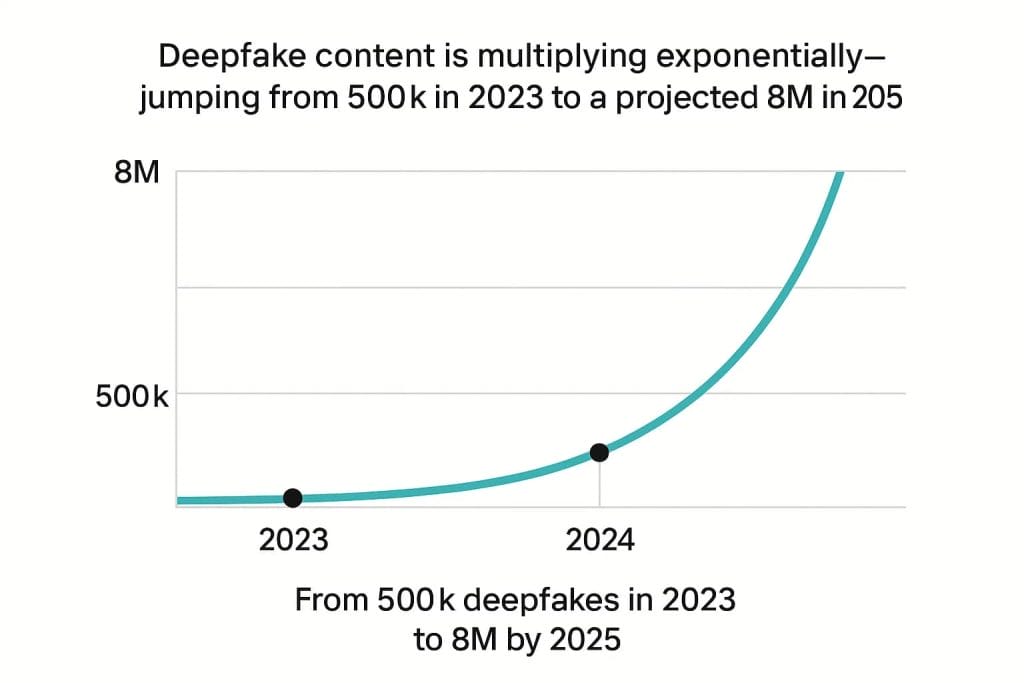

Rozwój technologii AI pozwala na przejście od prawie manualnego etapu tworzenia deepfake’ów do masowej, zautomatyzowanej i profesjonalnej produkcji, w której narzędzia sztucznej inteligencji umożliwiają praktycznie każdemu użytkownikowi tworzenie wysokiej jakości, fałszywych, syntetycznych mediów niemal przy zerowych kosztach.

Deepfake prosty i szybki

Bezpłatne narzędzia open source, platformy „deepfake jako usługa” i przyjazne dla użytkownika oprogramowanie pozwalają osobom niebędącym ekspertami na generowanie przekonujących acz fałszywych treści w ciągu kilku minut. Upgrade modelu Sora 2 firmy OpenAI i Veo 3 od Google oraz aplikacje startupów sprawiają, że każdy może opisać pomysł, pozwolić dużemu modelowi językowemu, takiemu jak ChatGPT lub Gemini, naszkicować skrypt i wygenerować dopracowane materiały audiowizualne w ciągu kilku minut.

Korzystaniu z tych narzędzi sprzyja obfitość danych szkoleniowych: Publicznie dostępne materiały audio i wideo na platformach takich jak TikTok, YouTube i LinkedIn umożliwiają łatwe klonowanie podobizn, gestów i zachowań milionów ludzi. Bazując na nich, oszuści mogą wykorzystywać technologię autonomicznych agentów do identyfikacji osób, które staną się ofiarami oszustw za pomocą spersonalizowanych scenariuszy generowanych z szybkością, której tradycyjne mechanizmy bezpieczeństwa nie są w stanie wykryć.

Sposoby działań

Schematy działań przestępów mogą być banalnie proste. Wystarczy do tego pobranie z mediów zapisu kilkusekundowej rozmowy prezesa firmy, aby wygenerować jego realistyczną kopię z poleceniem wykonywania konkretnego zadania adresowaną do pracowników firmy. Często chodzi o pilny transfer środków na podane konto. Ofiarami podobnych działań mogą być też zwykli ludzie, których głos może pochodzić z trwającej kilkanaście sekund rozmowy telefonicznej, która odbierana jest jako pomyłka.

Oszuści wykorzystują także awatary wygenerowane przez AI do przeprowadzania rozmów kwalifikacyjnych na zdalne stanowiska inżynierskie, kradnąc pensje i poufne informacje firmowe i podszywając się pod inne osoby w czasie rzeczywistym.

Do stosunkowo nowych, masowych oszustw bazujących na deepfake należy wykorzystywanie emocji właścicieli rzekomo zagubionych zwierząt połączone z niewielką opłatą za ich odzyskanie.

Deepfake’i wykorzystywane są też coraz częściej do wpływania na wybory poprzez manipulowanie opinią publiczną i rozpowszechnianie fałszywych wiadomości. Do tworzenia ich zostały do tej pory wykorzystane wizerunki blisko tysiąca polityków na świecie. Do niedawnych przypadków należą fałszywe obrazy deepfake premiera Australii Zachodniej R. Cooka, reklamującego program inwestycyjny oraz fałszywe nagranie video przedstawiającego ostatecznego zwycięzcę wyborów w Irlandii wycofującego swoją kandydaturę.

Globalny biznes

Fałszywe treści, obrazy i głosy to część ogromnego, światowego przemysłu dezinformacji, który przez firmę analityczną Sopra Steria szacowany był w roku 2024 na ponad 400 mld dol. czyli na poziomie PKB Danii. Na tym rynku segment deepfake wygenerował 11-12 mld dol. przychodów, a raczej strat oszukanych i okradzionych firm, instytucji publicznych i osób fizycznych. To jedna czwarta kryminalnych zastosowań sztucznej inteligencji. Interpol, międzynarodowa organizacja współpracy organów ścigania zaangażowana także w zwalczanie przestępstw wykorzystujących AI, w tym technologię deepfake’ów, podaje, że od tego roku oszustwa na bazie AI stały się o 450%. skuteczniejsze niż tradycyjne oszustwa finansowe, generując miliardy dolarów strat na całym świecie.

Dlatego Raport Światowego Forum Ekonomicznego (WEF) Global Risks Report 2026 umieścił dezinformację wśród najważniejszych krótkoterminowych zagrożeń globalnych, obok konfrontacji geoekonomicznej i polaryzacji społecznej. Jest to jedno z niewielu zagrożeń, które zostało uznane za poważne zarówno w perspektywie dwu-, jak i dziesięcioletniej. Źródło grafiki.

Startupy na ratunek

Rozpowszechnienie technologii deepfake staje się okazją biznesową dla nowych firm technologicznych. Globalny rynek wykrywania deepfake’ów doświadcza dynamicznego wzrostu. Szacuje się, że jego wartość w 2024 r. wyniosła około 6,3 mld dol, a do 2032 r. ma rosnąć średniorocznie w tempie prawie 40% do ponad 86 mld dol. W związku z dezinformacją opartą na sztucznej inteligencji i zagrożeniami cyberbezpieczeństwa rośnie zapotrzebowanie na narzędzia identyfikujące anomalie twarzy, niespójności audio i wykorzystywanie mediów syntetycznych w bankowości, finansach, mediach i administracji publicznej. Do wykrywania anomalii w obrazach i video stosowane są obecnie narzędzia wykorzystujące uczenie maszynowe i sztuczną inteligencję (72%), a także techniki przetwarzania i analizy obrazu. Największy udział w tym rynku mają USA (35%) i Europa (26%).

Rośnie szybko liczba startupów specjalizujących się w wykrywaniu deepfake’ów. Do największych należy amerykański Pindrop, który pozyskał prawie pół miliarda finansowania od funduszy venture capital, a jego wycena bliska jest miliarda dolarów co da mu status jednorożca. Jego platforma „Pulse” została zaprojektowana specjalnie do analizy głosu i zachowań podczas połączeń w celu identyfikacji głosów syntetycznych.

Z kolei Reality Defender, także z USA, umożliwia firmom i rządom wielomodalne wykrywanie deepfake’ów w czasie rzeczywistym. To ceniony za proaktywną obronę przed mediami generowanymi przez AI startup. Warto też wspomnieć o Adaptive Security, młodej firmie z branży cyberbezpieczeństwa, która rozwija usługi w zakresie obrony przez deepfake’ami i socjotechniką. Stoi za nią potentat branży sztucznej inteligencji – OpenAI i znany fundusz VC Andreessen Horowitz.

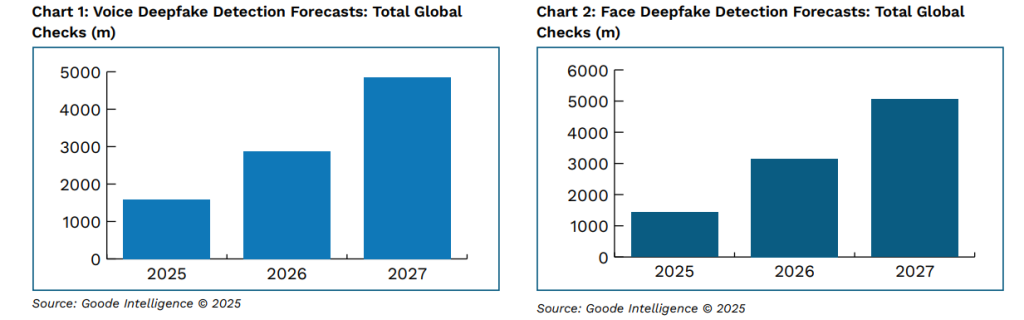

Natomiast holenderski startup Sensity AI specjalizuje się w analizie zagrożeń wizualnych wykorzystując technologię głębokiego uczenia do wykrywania zmanipulowanych materiałów multimedialnych i zapewnia analizę na poziomie kryminalistycznym. Liczba startupów w branży detekcji syntetycznych obrazów szybko rośnie. W 2023 roku rynek wyceniany był na 5,5 mld dol. a w bieżącym może osiągnąć nawet 15 mld dol. bo popyt na oferowane narzędzia detekcji i ochrony jest znaczny. Dzięki proliferacji tych narzędzi wzrastać będzie liczna wykrywanych oszustw deepfake. W 2025 roku zidentyfikowano na świecie 1,6 mld fałszywych głosów i 1,4 mld syntetycznych twarzy, w 2026 ma to być odpowiednio prawie 4,8 mld głosów i 5 mld fałszywych twarzy.

Implementacja zabezpieczeń

Coraz więcej firm na świecie wdraża narzędzia do wykrywania deepfake’ów, które oferują analizę w czasie rzeczywistym, mając na celu powstrzymanie oszustw opartych na obrazach w procesach onboardingu i weryfikacji tożsamości. Metadane kryptograficzne oraz zaawansowane metody uwierzytelniania treści, takie jak cyfrowe znaki wodne i kryptograficzne podpisywanie materiałów w momencie ich tworzenia, są obecnie uznawane za najskuteczniejszą, proaktywną broń przeciwko dezinformacji generowanej przez deepfake’i.

Takie rozwiązania przyjęła też Koalicja na rzecz pochodzenia i autentyczności treści (C2PA), do której należą firmy technologiczne (m.in. Intel i Microsoft) i medialne (BBC). Dane uwierzytelniające dokładnie określają, kiedy i jak treść została utworzona, a także dalsze działania podejmowane przez produkty w celu jej modyfikacji, zapewniając w ten sposób weryfikowalny zapis pochodzenia treści i modyfikacji. Odniesienia do deepfake’ów zawiera także unijny akt o sztucznej inteligencji (EU AI Act), który ma wejść w życie jeszcze w tym roku. Artykuł 50 wymaga oznaczania treści generowanych przez AI oraz ujawniania syntetycznych interakcji. Brak spełnienia tych wymogów wiązać się będzie z karami finansowymi do 6% globalnych przychodów firm.

Świadomość i edukacja

Sama technologia i procedury mogą jednak nie wystarczyć. Deloitte w swojej analizie wskazuje, że najgroźniejszym długoterminowym zagrożeniem może stać się erozja zdolności poznawczych pracowników. W miarę jak coraz częściej wykorzystują oni narzędzia AI do wykonywania zadań, narastają obawy, że mogą utracić zdolność krytycznej oceny treści i rozwiązań podsuwanych przez technologię. Wyraziło je aż 42 proc kadry kierowniczej firm badanych przez Deloitte. Niską świadomość funkcjonowania deepfakeów potwierdza sytuacja w Polsce przedstawiona w Cyberportrecie polskiego biznesu:

- aż 58% zatrudnionych w polskich firmach nie wie, czym jest deepfake;

- 19% pracowników udostępnia narzędziom AI wrażliwe dane firmowe;

- 30% badanych uznało wideo AI za prawdziwe i nie umiało ocenić jego autentyczności;

- ponad połowa pracowników badanych firm nie odbyła żadnego szkolenia z zakresu cyberbezpieczeństwa w ciągu ostatnich pięciu lat.

Widać więc, że firmom brakuje podstawowej odporności na zagrożenia wynikające z AI i technologii deepfake. A podstawowe zasady sprowadzają się zasadniczo do trzech przykazań: nie ufaj, sprawdzaj, nie działaj pod presją. Powinny one dotyczyć wszystkich, nie tylko firm. Potrzebna jest jednak edukacja w tym zakresie. W niewielu krajach ma ona miejsce.

W Finlandii dzieci już na etapie szkoły podstawowej uczą się rozpoznawać i oceniać, kiedy mogą paść ofiarą szkodliwych, manipulacyjnych treści. Samodzielnej ocenie służyć może odpowiedź na sześć kluczowych pytań: kim jest osoba, która próbuje się ze mną komunikować; jak i dlaczego mnie znalazła; co zyskuje, komunikując się ze mną; czy i jak mogę zweryfikować prawdziwość jej przekazu; czy narażam się na krzywdę, jeśli przyjmę jej przekaz; i czy mogę narazić się na krzywdę innych, jeśli będę ją dalej udostępniać?

Wydaje się, że nic nie stoi na przeszkodzie, aby takie treści przekazywane były także w polskich szkołach. To przecież istotna część podstawowej higieny cyfrowej. Kiedy powstanie specjalny program edukacji na ten temat?

Źródło zdjęcia: Tom Kotov/Unsplash

0 komentarzy

0 komentarzy