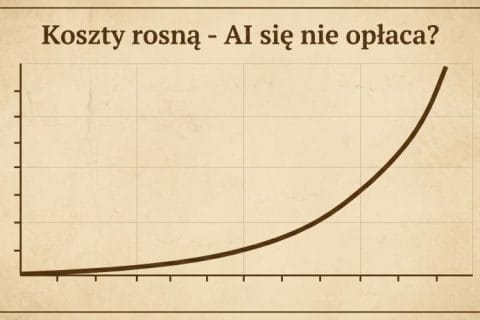

Do niedawna postęp uczenia maszynowego w sektorze zdrowia był znacznie wolniejszy niż np. w finansach, handlu, marketingu czy e-commerce. Od kilku lat medycyna dojrzała do szerszego zastosowania sztucznej inteligencji. Najnowsze analizy przewidują, że do 2025 roku wydatki na AI w służbie zdrowie urosną do 41,3 mld dolarów w skali świata.

Dla porównania w 2018 roku ogólne wydatki na służbę zdrowia w skali świata szacuje się 8,45 biliona dolarów i mają wzrosnąć do 11,9 miliona w 2022 roku. Dotyczy to głównie obszarów od automatycznej diagnostyki, monitorowanie pacjentów oraz badań nad szczepionkami i nowymi lekami[1] [2] .

Pandemia i izolacja stały się katalizatorem rozwoju usług telemedycznych.

Piszemy też o rozwoju innych obszarów w pandemii w artykule Joanny Szałkowskiej.

Jednocześnie firmy farmaceutyczne otrzymały praktycznie nieograniczone środki na prace badawcze w poszukiwaniu szczepionki na koronawirusa. Duża część z tych funduszy wykorzystywana jest na rozwój modeli wykorzystujących uczenie maszynowe.

Sztuczna inteligencja jest już bardzo skuteczna w rozpoznawaniu chorób. Tutaj najbardziej przydatne są sieci neuronowe specjalizujące się w rozpoznawaniu obrazu. Ta technologia znajduje od kilku lat zastosowanie w dermatologii.

Sztuczna inteligencja wspiera diagnozy

Błędy w diagnozie są jednym z największych wyzwań medycyny. Szacuje się, że mogą być odpowiedzialne nawet za 10% zgonów pacjentów. Uczenie maszynowe doskonale nadaje się do automatyzacji diagnoz. Wszystko dzięki rozwojowi technologii rozpoznawania obrazu. Tutaj punktem zwrotnym było zwycięstwo sieci neuronowej AlexNet w konkursie na rozpoznawanie obrazu ImageNet w 2012 roku.

Algorytm był pierwszą implementacją konwolucyjnej sieci neuronowej (CNN) z użyciem naprawdę szybkiego procesora. Sukces AlexNet rozpoczął rewolucję w rozwoju systemów rozpoznawania obrazów wykorzystujących tzw. głębokie uczenie (Deep Neural Networks, DNN).

Pierwszą specjalizacją, gdzie odniesiono imponujące wyniki była radiologia. Algorytmy tak trafnie interpretowały zdjęcia rentgenowskie, że w 2016 brytyjski psycholog i informatyk Geoffrey Hinton stwierdził, nawiązując do kreskówek Warner Bros, że „radiolodzy są jak kojot, który już zbiegł w przepaść, ale jeszcze nie spojrzał w dół”. Przewidywał, że specjaliści podzielą los innych wymarłych profesji. Już wtedy sieci neuronowe rozpoznawały anomalia w zdjęciach rentgenowskich skuteczniej niż doświadczeni lekarze.

W 2017 naukowcy z Uniwersytetu Stanforda stworzyli algorytm CheXNet, który był w stanie precyzyjnie diagnozować 14 schorzeń na podstawie analizy zdjęć rentgenowskich. W przypadku zapalenia płuc wyniki były trafniejsze niż rezultat pracy doświadczonego radiologa. W tym samym roku algorytm głębokiego uczenia z Uniwersytetu Stanforda identyfikował nowotwory skóry równie dobrze, co doświadczony specjalista. Aby to osiągnąć, program przeanalizował ponad 129 tys. zdjęć medycznych obrazujących ponad 2 tys. różnych schorzeń.

Chiny wyprzedzają świat?

W ostatnich latach Amerykanów dogonili, i być może już przegonili, Chińczycy. W czerwcu 2018 opracowany w Pekinie algorytm BioMind pokonał zespół złożony z 15 wybitnych lekarzy w diagnozowaniu nowotworów mózgu. Maszyna zidentyfikowała poprawnie 87 procent z 225 przypadków w ciągu 15 minut, podczas gdy ludzkiemu zespołowi zajęło to dużo więcej czasu i udało się trafnie zdiagnozować zaledwie 66 procent.

Kolejną rundą starcia było rozpoznanie krwotocznych udarów mózgu. BioMind wskazał 83 proc. trafnie, podczas gdy lekarze 63 procent. W przypadkach łatwiejszych do zdiagnozowania, takich chorób neurologicznych jak oponiak czy glejak, sieć neuronowa trafnie oceniła dziewięć na dziesięć przypadków, co jest dobrym wynikiem dla doświadczonego ludzkiego specjalisty.

Chińscy badacze mają do dyspozycji praktycznie tę samą technologię co Amerykanie. Ich przewagą nad Zachodem jest dostęp do danych osobowych, których w tamtejszej kulturze nie chroni się tak, jak w naszej. BioMind przeanalizował tysiące zdjęć rzeczywistych przypadków z pekińskich szpitali.

Osobną kategorią zastosowania sztucznej inteligencji jest modelowanie w ramach drug discovery. Dobrym przykładem jest tu węgierska firma Turbine próbuje wykorzystać sztuczną inteligencję do badań nad leczeniem nowotworów. Modele AI są wykorzystywane do symulowania zmian w komórkach na poziomie molekularnym. Wirtualne symulacje pozwalają zaprojektować niezliczoną liczbę scenariuszy, biorąc pod uwagę kombinacje lekarstw i procedur.

Czy roboty zastąpią lekarzy?

Entuzjaści rozwoju sztucznej inteligencji, tak jak Geoffrey Hinton, już wiele lat temu położyli kreskę na większości specjalizacji lekarskich. Przemawia do nich metafora kojota z kreskówki. Jednak czas pokazuje, że szanowana i złożona profesja lekarza przetrwa presję ze strony automatyzacji.

Rozwój sztucznej inteligencji w medycynie blokują dwie powiązane ze sobą duże przeszkody: odpowiedzialność osobista za leczenie oraz zjawisko „czarnej skrzynki” (black box).

Trudno w obecnym układzie społeczno-prawnym w większości krajów na świecie wyobrazić sobie sytuację, w której odpowiedzialność za leczenie pacjenta bierze na siebie autor programu komputerowego, czy sama sztuczna inteligencja (ona zresztą nie ma osobowości prawnej). Błąd algorytmu wykorzystywanego przez tysiące albo miliony pacjentów doprowadziłby do fali pozwów, które obaliłyby nawet takich gigantów jak Google czy Amazon.

Czarna skrzynka to powszechny problem w budowie rozwiązań sztucznej inteligencji opartych na sieciach neuronowych. Tradycyjne techniki, takie jak drzewo decyzyjne, nie potrafią się uczyć, ale mają jedną dużą zaletę – są przejrzyste i zrozumiałe dla programisty. Człowiek jest w stanie prześledzić, jak program komputerowy doszedł do danego rezultatu.

Tymczasem inżynierowie i naukowcy, którzy stworzyli i wytrenowali sieć neuronową, widzą jedynie dane wejściowe oraz wynik. Program efektywnie zdiagnozuje nowotwór, ale nie wiadomo na jakiej podstawie. Inżynierowie z DeepMind nie mają pojęcia, jak AlphaZero doszedł do innowacyjnych posunięć, które tak zachwycały arcymistrzów. O ile w przypadku gry czy optymalizacji sprzedaży w sklepie internetowym nie jest to problemem, to już w przypadku medycyny – owszem, i to poważnym.

Czy wybrałbyś lekarza, który w 80% przypadków ma rację, ale potrafi wyjaśnić logikę stojącą za jego diagnozą, czy też lekarza stawiającego w 90% trafną diagnozę, ale nie umiejącego jej wyjaśnić? Takie pytanie postawił na Twitterze badacz algorytmów Pedro Domingos.

Najbardziej prawdopodobny wydaje mi się scenariusz, w którym lekarz wykorzystują rozwiązania AI, aby stawiać dokładniejsze diagnozy i leczyć pacjentów efektywniej. Praca lekarza to złożony proces składający się z wielu elementów i wielostopniowej zależności. Trzeba zrozumieć pacjenta, skomunikować się z nim, porozmawiać na temat możliwych sposobów leczenia przypadku, zbadać, przeanalizować wyniki, wreszcie sporządzić diagnozę i zakomunikować ja pacjentowi.

Dlatego w przewidywalnej przyszłości sztuczna inteligencja ograniczy się do wsparcia pracy lekarzy. Między innymi do tego już teraz stosują sieci neuronowe polskie firmy. Jeszcze przed wielkim boomem na telemedycynę spowodowanym pandemią polski startup Telemedi.co wspierał swoje usługi sztuczną inteligencją.

Algorytmy leczą polskich pacjentów

W Telemedi.co sieci neuronowe wykorzystywane są do tworzenia automatycznego kontekstu zdalnej konsultacji lekarskiej. Algorytm podsuwa pacjentowi spersonalizowaną ankietę, na podstawie której tworzy wstępne rozpoznanie dla lekarza. Inne algorytmy szkolone są w podejmowaniu kluczowej decyzji: czy dany przypadek nadaje się na zdalną konsultację, czy też niezbędna jest wizyta u lekarza. Trzecia grupa algorytmów Telemedi.co wypełnia dokumentację medyczną – biurokratyczny obowiązek, który jest zmorą polskich lekarzy. Dzięki automatyzacji człowiek jedynie czyta, koryguje i zatwierdza dokument.

Sieci neuronowe świetnie współgrają z urządzeniami monitorującymi organizm pacjenta. Polska firma StethoMe produkuje „inteligentne stetoskopy”, które śledzą pracę układu oddechowego i serca. Zanonimizowane dane wykorzystywane są właśnie do rozpoznawania ewentualnych problemów ze zdrowiem. Algorytmy już teraz są skuteczniejsze od lekarzy w wykrywaniu nieprawidłowości, ale leczenia samodzielnie nie podejmą..

Sztuczna inteligencja w sektorze zdrowotnym będzie nabierała tempa. W bogatych krajach uczenie maszynowe będzie wykorzystywane do zwiększenia efektywności leczenia i profilaktyki. Jednak robotyzacja jest dużo bardziej potrzebna biednym. Według danych Światowej Organizacji Zdrowia połowa ludności na świecie nie ma dostępu do podstawowych świadczeń zdrowotnych. Automatyzacja może to zmienić, co pokazuje przykład diagnoz dermatologicznych. Sztuczna inteligencja dostarcza dziecku na indyjskiej prowincji dostęp do światowej klasy rozpoznania.

Inżynierowie trenujący algorytmy mają dostęp do coraz większych zbiorów zanonimizowanych danych, a sieci neuronowe i frameworki są coraz lepsze. W kolejnych obszarach zastosowań sztucznej inteligencji możemy się spodziewać przełomu podobnych do AlphaZero. Jeśli sieci neuronowe są w stanie zwrotnie uczyć się samodzielnie, czas potrzebny na ich wyszkolenie skróci się drastycznie. Wzrost mocy obliczeniowej związany z jakimś przełomowym odkryciem w dziedzinie budowy komputerów ( np. komputery kwantowe) może doprowadzić do kolejnego skoku.

Kluczowy dla dalszego rozwoju sztucznej inteligencji w medycynie na pewno będzie rozwój tzw. interpretowalnych algorytmów uczenia maszynowego, który pozwoli rozwiązać problem czarnej skrzynki. Takie rozwiązania już są wykorzystywane np. przy zapobieganiu hipoksemii podczas operacji [3] [4] .

Roboty nie zastąpią lekarzy, ale z czasem lekarze mogą zmienić się super medyków uzbrojonych narzędzia dające im niewyobrażalną dzisiaj moc i pozwalającą leczyć pacjentów szybciej, skuteczniej i taniej. Automatyzacja pozbawi pracy część personelu medycznego, tę wykonującą żmudne powtarzalne czynności. Dobrzy lekarze będą mogli skupić się na najważniejszych aspektach swojej pracy [5] [6] .

Badacze z King’s College w Londynie, Massachusetts General Hospital oraz prywatnej firmy medycznej ZOE wypracowali procedurę diagnostyczną pozwalającą zidentyfikować z dużym prawdopodobieństwem chorego na COVID-19 na podstawie symptomów. Metoda korzysta z modeli sztucznej inteligencji. Pacjenci mogą korzystać z niej za pośrednictwem aplikacji mobilnej Covid Symptom Study dostępnej w Google Play i App Storze. Samo uczący się algorytm już miesiąc temu, był w stanie z 80-procentową skutecznością wskazać, czy dana osoba może być nosicielem COVID-19 na podstawie wieku i płci pacjenta oraz szeregu symptomów.

Złota era AI w medycynie

W mediach mówi się naprzemiennie o sztucznej inteligencji (artificial intelligence, AI) oraz uczeniu maszynowym (machine learning, ML). Wprowadza to zamieszanie. Uczenie maszynowe to dziedzina ogólnych badań nad sztuczną inteligencją, która rozwija się od kilku lat w zawrotnym tempie dzięki zastosowaniu tzw. sieci neuronowych, coraz szybszym komputerom oraz badaczom, przedsiębiorcom i entuzjastom osób na całym świecie, którzy wykorzystują ogólnodostępną technologię do trenowania algorytmów na nowych zbiorach danych.

Potrafimy nauczyć algorytmy naśladujące mechanizmy działania mózgu – tzw. sieci neuronowe – szybko i precyzyjnie wykonywać wąsko określone zadania. Te wyspecjalizowane programy komputerowe już teraz potrafią kierować samochodem, a także diagnozować szereg chorób. Jednak wciąż daleka droga do choćby konceptualnej tzw. silnej sztucznej inteligencji (czy też ogólnej – general AI), która naśladowałaby umysł.

Przełomowym wydarzeniem w rozwoju sztucznej inteligencji było spektakularne zwycięstwo programu AlphaGo nad najlepszymi graczami go na świecie. Go jest niesłychanie złożoną grą. O ile w szachach po pierwszych dwóch ruchach gracze wybierają spośród 400. następnych posunięć, w go tych możliwości jest prawie 130 tys. Wybitni zawodnicy go to zarazem logicy i artyści.

AlphaGo stworzyła należąca do Google londyńska firma DeepMind. Inżynierowie na podstawie bazy danych zawierającej zapisy rozgrywek go przez lata szkolili maszynę. W 2016 roku program pokonał najlepszych graczy na świecie. Udało się to osiągnąć dzięki połączeniu najnowszych technik uczenia maszynowego z ogromną mocą obliczeniową.

Ale na tym nie koniec. Fenomen algorytmów uczących się polega na tym, że każdy sukces potrafią natychmiast przełożyć na kolejne. Ewoluują w mgnieniu oka. Kolejna generacja programu nie potrzebowała już ludzi. AlphaGo Zero grał sam ze sobą i w ten sposób osiągnął niespotykany poziom zaawansowania, wymyślając „kreatywne” posunięcia, które wprawiły arcymistrzów w osłupienie. Program potrzebował zaledwie 40 dni, aby przewyższyć wszystkie poprzednie wersje AlphaGo. Arcymistrzowie pozostali w lidze niżej. Polecam film dokumentalny o tej historii na YouTube.

Sztuczna inteligencja i uczenie maszynowe: gdzie jesteśmy?

Większość praktycznych zastosowań uczenia maszynowego jest znacznie mniej skomplikowana niż gra w go. Wyjątkiem jest kierowanie samochodem, szczególnie w ruchu z udziałem ludzi. Okazuje się, że rozgrywka, jaka toczy się między pieszym na pasach a samochodem, banalna dla każdego kierowcy, jest dla maszyny dużo bardziej złożona niż go. Jak na razie algorytmy nie radzą sobie ze zrozumieniem intencji pieszego – wejdzie na przejście czy poczeka i przepuści samochód. Ale i to jest tylko kwestią czasu.

Rozwój sztucznej inteligencji napędza demokratyzacja technologii. Jeszcze w latach 80. i 90. XX w. uczenie maszynowe było zarezerwowane tylko dla największych korporacji, takich jak amerykański IBM czy niemiecki Siemens. Obecnie najnowsze algorytmy dostępne są za darmo dla każdego zainteresowanego. Frameworki, czyli szkielety do budowy aplikacji czy też biblioteki programistyczne, wykorzystujące uczenie maszynowe i głębokie sieci neuronowe, są rozwijane przez technologicznych gigantów i udostępniane na licencjach open source pozwalających korzystać z nich za darmo.

W ten sposób Google rozpowszechnia najpopularniejszy framework TensorFlow, Facebook tak zbudował PyTorch, tak też działa ich konkurent Microsoft Cognitive Toolkit. Z tych projektów powstają kolejne platformy rozwijane przez społeczność użytkowników. To model znany z rozwoju języków programowania. Korporacje potrzebują rzeszy użytkowników, aby doskonalić swoje rozwiązania. Walczą też o dominację rynkową. Zautomatyzowany świat będzie korzystał z najlepszego frameworku, który stanie się standardem.

(Zdjęcie autorstwa Anna Shvets z Pexels)

I just like the helpful information you provide in your articles