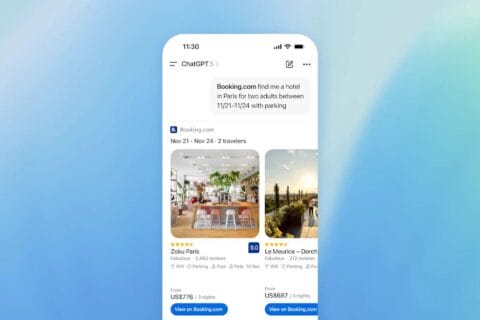

W zeszłym tygodniu świat obiegła wieść – nowe umiejętności GPT-4o generowania obrazów okazały się naprawdę niesamowite. Szczególnie popularne stało się zamienianie zdjęć w komiksy „anime”. Choć ponownie budziło wątpliwości, na jakich treściach firma Sama Altmana trenowała swoje dane.

Obrazy z GPT-4o spowalniają OpenAI

Ta popularność – i wysokie wymagania co do mocy obliczeniowych przy generowaniu obrazów przez GPT-4o – spowodowała jednak istotne przeciążenie infrastruktury OpenAI. Już w zeszłym tygodniu Sam Altman pisał, że karty GPU firmy „się topią”, a wtedy jeszcze – jak o tym pisałem parę dni temu – nie wszyscy mieli do tej funkcjonalności dostęp. Teraz tworzenie obrazów jest dostępne dla każdego użytkownika.

Oczywiście spowolnienie GPT-4o – o którym wspominał na przykład znany komentator świata AI Matthew Berman – mogło być w części spowodowane pojawieniem się w ostatnich dniach nowego, zaktualizowanego modelu GPT-4o. Ten model ma naprawdę lepsze osiągi niż poprzednik. Obecna wersja zajmuje drugie miejsce w rankingu LM Arena, podczas gdy poprzednia wersja modelu jest sporo niżej, dopiero w trzeciej dziesiątce rankingu.

Powiedzmy sobie jednak szczerze, to nie ulepszone możliwości tekstowe modelu przyciągnęły do ChatGPT tłumy. Tym czymś była możliwość generowania obrazów, z której skorzystała na przykład administracja Trumpa do stworzenia propagandowych wpisów na mediach społecznościowych.

To spowolnienie ma nie tylko wymiar związany z wygodą użytkowników, ale i z budowaniem nowych modeli firmy, co zasugerował Altman na platformie X. Dowiedzieliśmy się, że premiery nowych produktów zostaną opóźnione.

„Opanowujemy sytuację, ale musicie liczyć się z tym, że nowe wydania od OpenAI będą opóźnione. Mogą występować awarie, a usługi czasami będą działać wolniej, ponieważ radzimy sobie z wyzwaniami dotyczącymi przepustowości” – napisał Altman.

Nowa infrastruktura będzie kosztować, ale… OpenAI na to stać

Wygląda na to, że firma Altmana będzie potrzebowała dodatkowej infrastruktury. To musi oczywiście potrwać, ale nie powinno być większym problemem. Spółka właśnie pozyskała 40 mld dolarów od grupy inwestorów pod przewodnictwem japońskiego Softbanku, partnera OpenAI w projekcie Stargate. Nowa runda finansowania wycenia OpenAI na poziomie 300 mld dolarów, a więc trzykrotnie wyżej niż obecnie wynosi wartość rynkowa Intela.

Nie powinno być również większych problemów ze znalezieniem centrów danych, z których OpenAI mogłoby skorzystać. Jak ostatnio donosiły media, Microsoft ponownie zrezygnował z umów na centra danych, tym razem w USA i Europie. Chodzi najwyraźniej o mniejszy popyt na usługi chmurowe.

Niewykluczone więc, że mamy pierwsze widoczne skutki przewidywanego „efektu DeepSeeka”. Część firm „przesiada się” na mniejsze darmowe modele, które często są również wydajniejsze pod względem mocy obliczeniowych. A to redukuje popyt na usługi centrów danych dla AI. Jak donosi The Information, na taki ruch zdecydowało się już kilka firm. W tym – zajmująca się cyberbezpieczeństwem The Palo Alto Networks, która odeszła od najnowszych i najdroższych modeli na rzecz modeli otwartych.

Źródło obrazka: Sztuczna inteligencja, model GPT-4o

0 komentarzy

0 komentarzy