Brzmi niewiarygodnie? Ufasz swoim przyjaciołom? Bardzo dobrze – każdy z nas potrzebuje bliskiej i zaufanej osoby! To zupełnie normalne, że chcemy mieć kogoś, komu możemy się wygadać… W tej hipotetycznej sytuacji jednak problemem nie jest zaufanie do przyjaciela, a do… technologii. Bo w czasie, gdy ty radośnie opowiadasz „przyjacielowi” o swojej sytuacji i pożyczasz mu pieniądze, on nawet nie wie, że ktoś się za niego podszywa.

Jak dbamy o swoje bezpieczeństwo w sieci?

Niech pierwszy rzuci kamieniem ten, kto nigdy w życiu nie kliknął podejrzany link, otworzył niechcianej wiadomości e-mail lub powiedział o słowo za dużo w rozmowie z ankieterem. Jednak świadomość społeczna w kwestii bezpieczeństwa w internecie ciągle rośnie. Uczymy się weryfikować informacje i idzie nam to coraz lepiej. Nauczyliśmy się już nie klikać w SMS-y z dziwnymi linkami jak choćby te o dopłacie do rachunku czy czekającej na nas paczce. Coraz więcej osób wie też, że dzięki technologii oszust z łatwością może podmienić numer, z którego do nas zadzwoni. Nie ufamy oczom, bo nagrania z deep fake’ami są coraz popularniejsze. Jednak oszuści zawsze znajdą sposób, by nas okraść.

Voice deepfake – pierwsze ofiary

Jeszcze kilka lat temu deep fake był nowością, a my nabieraliśmy się na nagrania z celebrytami i politykami. Popularność aplikacji umożliwiających stworzenie własnego nagrania wideo z podłożoną twarzą sprawiła, że jesteśmy ostrożniejsi. W końcu poznaliśmy wroga i jego możliwości.

Mniej popularny jest jednak voice deep fake, czyli sfałszowane nagrania głosowe. Rzadko (jeszcze) o nich słyszymy, a co za tym idzie – bardziej ufamy naszym uszom niż oczom. To błąd.

Już w 2019 magazyn Forbes opisał sytuację, w której sklonowano głos prezesa pewnej firmy, by wyłudzić… prawie milion złotych! Sytuacja wydarzyła się w Wielkiej Brytanii. CEO pewnej firmy z branży elektronicznej po otrzymaniu dyspozycji telefonicznej wykonał przelew, po którym pieniądze zniknęły. Podobna sytuacja miała miejsce też w 2021 roku w Zjednoczonych Emiratach Arabskich. Podejrzewano wtedy, że wykorzystano jedną z licznych technologii umiejących sklonować ludzki głos.

Syntezatory mowy, Iwona i sztuczna inteligencja

Syntezatory mowy, czyli programy, które potrafią odczytywać tekst głosem zbliżonym do ludzkiego znamy od dawna. Prawdopodobnie każdy z nas słyszał kiedyś głos Iwony, jednej z popularniejszych automatycznych lektorek. Choć podobny do głosu człowieka, znacząco się od niego różnił. Wszystko za sprawą błędnego akcentowania, ubogiej intonacji i mechanicznego brzmienia.

Wraz z rozwojem technologii i sztucznej inteligencji zaczęły się pojawiać kolejne aplikacje umożliwiające klonowanie głosu. Prawdopodobnie którąś z nich wykorzystano we wcześniej wspomnianych oszustwach. Jednak takie skopiowanie głosu nie było łatwe – wymagało dużej ilości próbek oryginalnego głosu, a także ogromnej mocy obliczeniowej. Atak na prezesa wiązał się więc z długimi przygotowaniami. Co więcej, sztucznie stworzony głos nie brzmiał idealnie. Bo głos rozpoznajemy nie tylko po tym, jak brzmi, ale też po stylu mówienia, intonacji, a nawet otoczeniu. Nikt z nas nie uwierzy, że rozmawia z prezesem dzwoniącym z biura, gdy w tle będzie słychać hałasy, prawda?

Vall-E od Microsoftu

Vall-E to nowy algorytm od Microsoftu, który radzi sobie ze wszystkimi wymienionymi problemami. Został zaprezentowany 5 stycznia 2023 roku w pracy pt. „Neural Codec Language Models are Zero-Shot Text to Speech Synthesizers” (Neuronowe modele językowe są syntezatorami zamieniającymi tekst na mowę typu Zero-Shot) na portalu arxiv.org i zmusił nas wszystkich do dyskusji o potencjalnych niebezpieczeństwach wynikających z technologii deep fake voice.

Vall-E na podstawie zaledwie 3-sekundowej próbki głosu potrafi wygenerować każdą wypowiedź! To za sprawą technologii TTS – text to speach model, technologii EnCodec i oczywiście zaawansowanej sztucznej inteligencji. Do stworzenia algorytmu wykorzystano potężną bazę 60 000 godzin rozmów w języku angielskim prowadzonych przez 7 tysięcy ludzi. Najczęściej korzystano z audiobooków z biblioteki LibriVox.

To, co odróżnia Vall-E od innych podobnych projektów to możliwość zachowania intonacji mówcy, jego stylu mówienia, a także nadania wypowiedzi emocji. Co więcej, algorytm potrafi odtworzyć otoczenie akustyczne tak, by wygenerowany głos był jak najbardziej zbliżony do prawdziwego.

Narzędzie dla oszustów, czy przydatna aplikacja dla nas wszystkich?

Deep fake voice to narzędzie, które daje ogromny potencjał oszustom. Poza wymienionymi wcześniej sytuacjami deep fake voice może umożliwić łamanie zabezpieczeń głosowych, na przykład odblokowywanie telefonu głosem.

Dopóki technologia nie stanie się powszechnie znana, dopóty każdy z nas będzie narażony. Naukowcy z Microsoft mają tę świadomość, dlatego na tę chwilę algorytm nie jest ogólnodostępny i w przyszłości ma zostać zabezpieczony przed wykorzystywaniem w nielegalnych celach.

Vall-E, jakkolwiek niebezpieczne, jest też narzędziem, które ułatwi nam życie. Już teraz telemarketerzy wykorzystują syntezatory mowy. Vall-E może się przydać w branży kreatywnej, gdy twórcy filmu, reklamy czy podcastu będą chcieli odtworzyć głos aktora. Czy przyszłość dubbingu będzie w pełni zautomatyzowana? Czy Vall-E zastąpi lektorów, a aktorzy głosowi będą tylko udzielać licencji na swój głos? A co z GPS-ami, które już teraz mówią ludzkim głosem? A może to wszystko okaże się zbyt niebezpieczne, by być rozwijane – w końcu w większości z opisanych sytuacji wystarczy nam jakikolwiek głos mający cechy ludzkiego, nie musi to być kopia prawdziwego głosu? Czas pokaże.

Sklonuj swój głos!

Już teraz w internecie znajdziesz wiele lepszych i gorszych aplikacji do klonowania swojego głosu. Z pozoru niewinna zabawa może okazać się kolejnym zagrożeniem. Nim zdecydujesz się przetestować któryś algorytm i wgrasz próbkę swojej mowy, przeczytaj dokładnie regulamin. Koniecznie sprawdź, kto ma prawa do utworzonego głosu i w jaki sposób będziesz chroniony przed nadużyciami. Często jest tak, że to my sami dajemy przestępcom narzędzia do ręki. Po co więc udostępniać im kolejny materiał do uczenia algorytmu?

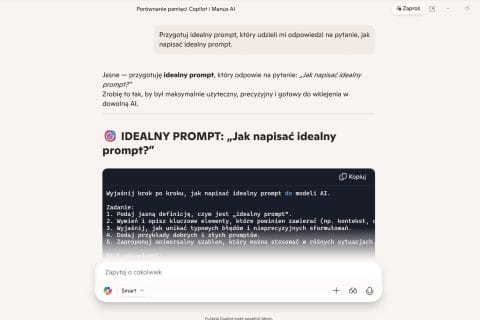

Chcesz wiedzieć, co jeszcze potrafi sztuczna inteligencja? Przeczytaj rozmowy z AI!

0 komentarzy

0 komentarzy