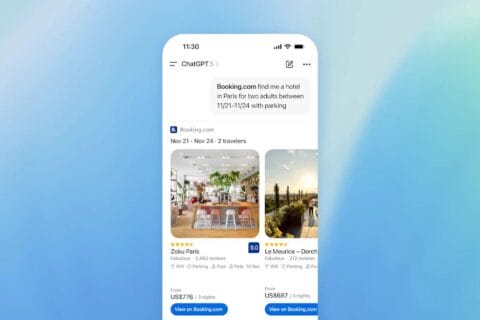

Najbardziej odczuwalną dla przeciętnego użytkownika internetu zmianą będzie prawdopodobnie wprowadzenie sztucznej inteligencji do wyników wyszukiwania. Jak dotąd opcja była dostępna tylko dla chętnych w programie SGE (Search Generative Experience). Teraz sztuczna inteligencja będzie generować wyniki wyszukiwania tam, gdzie uzna, że jej wkład może być pomocny dla użytkownika.

W takim przypadku, na górze wyników pojawi się podsumowanie wygenerowane przez AI (AI Overview) z co najwyżej kilkoma linkami (jak twierdzi portal 9to5Google, często linki pokazują się dopiero po rozwinięciu pełnego podsumowania AI), a same wyniki wyszukiwania znajdują się poniżej.

O tym jak (negatywnie) może wpłynąć na internetowych twórców wprowadzenie AI do wyszukiwania pisaliśmy w tym artykule.

AI w wyszukiwarce zostanie już teraz wprowadzone w USA i będzie stopniowo wdrażane w innych krajach świata, by pod koniec roku trafiać do 1 mld osób. Czy będziemy wśród nich? Trudno powiedzieć, ale znając historię implementacji innych technologii AI przez Google, UE będzie pewnie jednym z ostatnich miejsc, do których technologia ta dotrze.

Sztuczna inteligencja wejdzie również do Twojej przeglądarki, zwłaszcza jeśli używasz Google Chrome. Począwszy od wersji 126 (u mnie aktualnie jest 124), Chrome będzie wyposażony w model Gemini Nano, tak by deweloperzy aplikacji internetowych mogli korzystać ze sztucznej inteligencji również po stronie klienta (a nie przez zewnętrzny serwis). By upewnić się, że technologia ta się upowszechni, Google rozmawia z twórcami innych przeglądarek, takich jak Firefox czy Safari, nad wprowadzeniem do nich Gemini Nano.

Sztuczna inteligencja w szerszym zakresie trafi również do Gmaila i Google Docs. Gemini 1.5 Pro będzie dostępna w panelu bocznym w tych aplikacjach.

To nie są jedyne ogłoszenia of Google z Google I/O. Oto garść innych, również interesujących nowości:

- Google udostępni model generacji wideo Veo, który umożliwia tworzenie klipów o długości przeszło minuty w rozdzielczości 1080p.

- Firma uaktualniła swój model generacji grafiki Imagen do wersji 3. Teraz model ten produkuje lepszej jakości grafiki i lepiej radzi sobie z tekstem, co dotychczas było istotnym problemem dla modeli graficznych takich jak Dall-E.

- Do rodziny modeli Gemini dołączył Gemini Flash 1.5, model nieco słabszy od Gemini 1.5 Pro, ale istotnie szybszy, więc nadający się do zadań wymagających szybkiej odpowiedzi. Model ma imponujące okno kontekstowe wielkości 1 mln tokenów.

- Okno kontekstowe Gemini 1.5 Pro powiększono do 2 mln tokenów.

- Google DeepMind zaprezentował demo Projektu Astra – przyszłego asystenta AI.

- Google zaprezentował model Gemma 2 o wielkości 27 mld parametrów; model jest podobno istotnie lepszy od poprzednich wersji Gemmy, serii małych otwartych modeli od firmy z Mountain View. Niestety na laptopa go niestety zapewne nie zmieścicie.

- Pokazano również model PaliGemma, pierwszy z małych modeli, który potrafi rozumieć obrazy.

Liczba nowości od Google jest doprawdy przytłaczająca. Pojawia się tylko pytanie, czy udostępnienie przez OpenAI za darmo modelu GPT-4o o możliwościach podobnych do GPT-4, za to o większej prędkości, nadal nie przesłania tych dokonań. Zwłaszcza, że modele Gemini Ultra i Gemini 1.5 Pro, czyli jedyne modele Google mogące z grubsza konkurować z GPT-4, są wciąż dostępne tylko dla płacących klientów.

Prezentację Google z konferencji możecie obejrzeć tutaj.

Źródło grafiki: Sztuczna inteligencja, model Dall-E 3

0 komentarzy

0 komentarzy