Jeśli nie wiesz, dlaczego AI potrzebuje danych do nauki, posłuchaj podcastu o AI i prawach twórców.

Homo prawdziwie Sapiens

Dobrzy inżynierowie, programiści, naukowcy zajmujący się sztuczną inteligencją oraz specjaliści od danych nie spadają z nieba. Według raportów LinkedIn zapotrzebowanie na inżynierów przetwarzania języka naturalnego (ang. Natural Language Processing, NLP) i Data Scientists przekracza podaż i rośnie, bo przecież nie uczymy się tak szybko, jak tworzone przez nas modele.

Jednak wspomniana już kreatywność, chęć rozwoju i, w końcu, załapania się na pociąg (i zarobki), które cierpliwie czekają na kandydatów, sprawiają, że zainteresowanie wspomnianymi zawodami rośnie. Nie bez znaczenia pozostaje też prosta konieczność ułożenia życia w taki sposób, żeby było z czego zapłacić rachunki i kupić codzienną miseczkę ryżu.

Pecunia (non olet), czyli pieniądze

Przypomnijmy, że Sam Altman o mało nie stracił posady CEO OpenAI, kiedy zaczął szukać źródeł finansowania w Zjednoczonych Emiratach Arabskich, chcąc pozyskać od inwestorów 7 bilionów dolarów (tak, bilionów, to nie pomyłka w przekładzie terminologii angielskiej na język polski).

I dalej…

- Microsoft ogłosił w tamtym roku (2023) kolejne inwestycje w rozwój GPT-4 oraz jego integrację z usługami Microsoft Azure na drobną kwotę 10 miliardów dolarów.

- Anthropic, firma założona przez byłych pracowników OpenAI i rozwijająca przyjazną oraz poddaną rygorystycznej kontroli sztuczną inteligencję o nazwie Claude otrzymała w ramach inwestycji 580 milionów dolarów.

- DeepMind, firma badawcza AI przejęta przez Google (Alphabet Inc.), otrzymała około 1 miliarda dolarów od swojej spółki matki na rozwój AlphaFold i Gemini.

- Databricks rozwijająca platformę umożliwiającą analizę dużych zbiorów danych i trenowanie modeli AI pozyskała 1,6 miliarda dolarów już w I rundzie finansowania.

To tylko kilka przykładów pokazujących jak wielkie pieniądze płyną do projektów związanych z AI.

Jednak rosnące z dnia na dzień zapotrzebowanie na technologie sztucznej inteligencji oraz to, w jakim stopniu już teraz zmieniły praktycznie każdą branżę i sektor gospodarki (a przecież dopiero się rozkręcają), sprawia, że projekty związane ze sztuczną inteligencją przyciągają ogromny kapitał. Wszystko zgodnie ze starą zasadą: inwestuj i rozwijaj się, albo… giń.

Technologia, czyli na co idą te nieprawdopodobne kwoty

Zacznijmy może skromnie:

- Meta, czyli stary, dobry Facebook, intensywnie inwestuje w rozwój swojej infrastruktury sztucznej inteligencji, w tym w platformy GPU i zaawansowane systemy przechowywania danych budując wielkie klastry AI i optymalizując je pod kątem wydajności.

- Apple planuje wydać w 2024 roku 4,75 miliarda dolarów na zakup nowoczesnych serwerów AI (Nvidia HGX H100 i być może B100) chcąc wdrożyć funkcje generatywnej sztucznej inteligencji w iPhonach i iPadach.

- Według raportu IDC wydatki na infrastrukturę sprzętową, usługi IT oraz oprogramowanie systemowe niezbędne do rozwoju AI mają się podwoić w 2024 roku (i osiągnąć 151,1 miliarda dolarów w 2027 r.)

Powiedziałabym, że założeniom IDC brak rozmachu, ponieważ — chyba — nie uwzględniły poczynań szalonego geniusza, czyli Sama Altmana.

Sam Altman i jego globalna sieć zakładów produkujących chipy do AI

Jeśli zastanawialiście się, po co Samowi Altmanowi te kilka (5 do 7) bilionów dolarów, to właśnie na to. Na chipy i półprzewodniki — wąskie gardło naszej wspaniałej cywilizacji (tu odsyłam was do tekstu o strategicznym znaczeniu półprzewodników).

Projekt ma na celu, oczywiście, zaspokojenie rosnącego zapotrzebowania na zaawansowane procesory do AI, tym bardziej że — podobno — Open AI ma już gotowe projekty tych ostatnich. To o tyle ciekawe, że za projektowanie układów do AI wzięły się też Google, Meta i Microsoft, dążąc do zwiększenia szybkości i energooszczędności modeli AI, a także do zmniejszenia zależności od zewnętrznych producentów mikroprocesorów.

Podsumowując: tak ogromne inwestycje w infrastrukturę przyspieszą rozwój nowych technologii, a także zmienią równowagę na rynku produkcji mikroukładów.

Podstawowe zasoby, czyli energia, woda i sporo cennych minerałów

I tu robi się poważnie, bo nasze cywilizacyjne pomysły pochłaniają mnóstwo energii, wody oraz innych materiałów, i to niezależnie od tego, czy mówimy o sztucznej inteligencji, czy mediach społecznościowych, czy o rozwiązaniach opartych o blockchain.

Centra danych, ogromne moce obliczeniowe, zasilanie, chłodzenie — bez tego przez sieć nie przemknie najmniejszy bajt danych, a wszystkie uwielbiane przez nas technologie nie ujrzą światła dziennego.

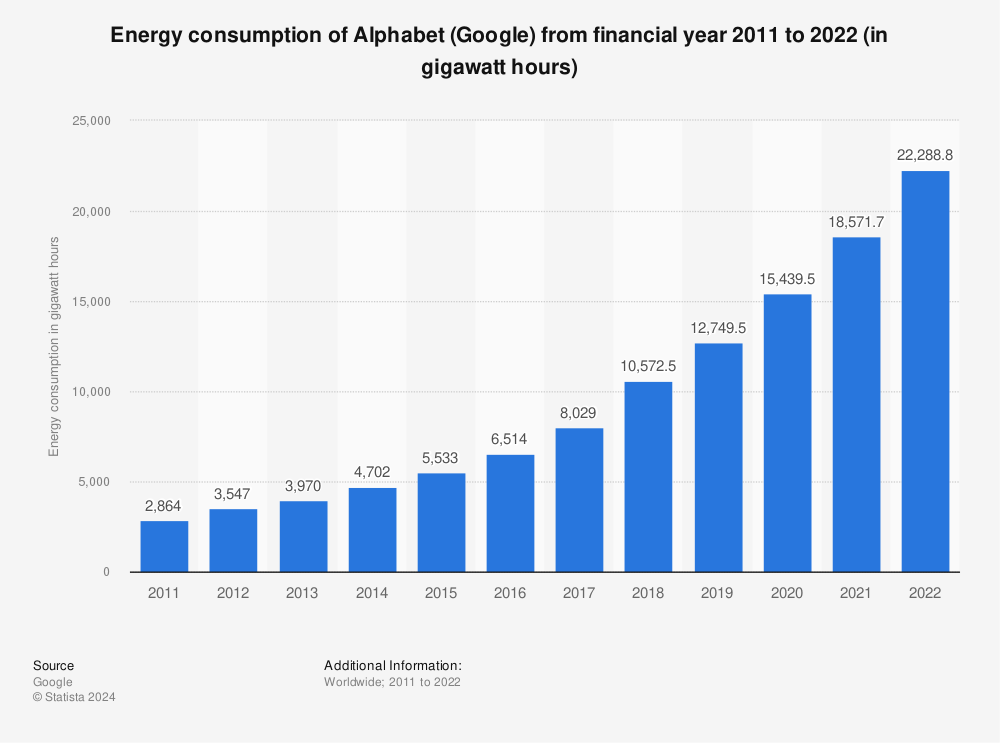

Szacuje się, że centra danych zużywają około 1% globalnej energii elektrycznej i ten odsetek nieustannie rośnie z powodu wzrastającego zapotrzebowania na obliczenia związane z AI i innymi technologiami. Na przykład, Google podało, że w 2020 roku ich centra danych zużyły 15,6 TWh energii elektrycznej. Dwa lata później zużycie wzrosło już do 22,3 TWh.

A woda? Cóż, wspomniane tu centra danych Google zużywają dziennie 1,7 mln litrów wody, a rocznie 1,67 × 1010 litrów. Dla porównania: Bałtyk ma około 2,17 1×1016 litrów wody i nie wystarczyłby superkomputerom Google na dwa lata.

Pozostaje jeszcze subtelna kwestia minerałów i pierwiastków rzadkich, jak krzem, selen, związki galu czy kadm, niezbędnych do wyprodukowania procesorów, układów oraz zbudowania centrów danych oraz sieci. Naprawdę nie jestem pewna, czy Ziemia długo wytrzyma nasze pomysły i zabawy.

I w końcu materiały treningowe, czyli nasza własność intelektualna

Większość z nas jest świadoma, że twórcy sztucznej inteligencji wykorzystali i wykorzystują jako materiały treningowe dorobek intelektualny całej ludzkości. Przyszli, wzięli (żeby nie powiedzieć „buchnęli”), a potem pokazali przeróbki naszych prac jako własne osiągnięcie.

Możecie powiedzieć, że tak właśnie rozwija się nasz gatunek. Bierzemy to, co stworzyły poprzednie pokolenia, dodajemy coś od siebie i powstaje nowa jakość.

I właśnie o to „dodajemy coś od siebie” mi chodzi.

Uważam, że sztuczna inteligencja nie dodaje do naszego twórczego wysiłku żadnej wartości. Po prostu korzysta z dostępnych danych i wyplata z nich swoje odpowiedzi, zdjęcia i filmiki. To tak jakby wrzucić do wielkiego kosza nasze pocięte na bajty prace (dane), a potem wybierać te fragmenty, które z największym prawdopodobieństwem pasują do układanki, czyli promptu. Nie wiem, ile danych zgromadziła ludzkość w sieci, ale to skończona, choć ogromna ilość. Dlatego też skończona jest liczba kombinacji dostępnych danych i jeśli, w tym momencie, przestalibyśmy wrzucać w sieć nowe materiały, to po skończonym czasie sztuczna inteligencja zaczęłaby się powtarzać.

Tu zaproszę was do fascynującej lektury pozwu, który złożył New York Times przeciwko OpenAI i Microsoft. Na 60 stronach NYT pokazuje, jak OpenAI generuje treści na podstawie jego materiałów schowanych za paywallem (sic!) i pyta, czy to aby fair dmuchnąć komuś bez pytania 100 lat ciężkiej intelektualnej pracy wielu dziennikarzy, reporterów i analityków. Pozew czyta się jak najlepszą książkę sensacyjną i zdecydowanie nie powinniście go przegapić.

Sztuczna inteligencja zużywa ogromne ilości zasobów

Jak widać za naszą technologią, w tym sztuczną inteligencją, stoi to co zwykle, czyli — delikatnie mówiąc — niefrasobliwe podejście do zużywanych zasobów. Używamy ich w imię, tak naprawdę, zabawy. Bo przecież bez wielu nowinek technologicznych spokojnie moglibyśmy się obejść.

Zastanawiam się też, czy przy tym tempie rozwoju i nieuniknionej walki o zasoby nie czeka nas opisany przez Franka Herberta w Diunie, Dżihad Butleriański, po którym ludzkość zmuszona by została do pójścia ścieżką rozwoju intelektualnego, a nie technologicznego. W sumie przydałoby nam się, bo — jak donoszą różne źródła — obecne technologie sprawiają, że maleje jeden z ważniejszych zasobów człowieka. Inteligencja.

0 komentarzy

0 komentarzy